HMD用のマスクを作ろう

public void onCreate() {

Mask myMask = new Mask();

}

残念、マスククラスはないです(Androidの人)

今日は、HMDをかぶるときに着ける自分用マスクを作ろう!

のお話。

なお、今まではこちらを愛用していた模様。

さぁ作ろう!(ノープラン)

今回、ミシンを使うので友人(と勝手に言うけど、会社の人)宅にお邪魔して(しかもお泊り)作成しました。

一度一緒にゲーセンのVRを体験しているので、何を作りたいのかはすぐ理解してくれました。

ちなみにVRやってきたのはここ↓

ニンジャマスクの一枚でもあればよかったのですが、何もなくて、フリーハンドで型紙起こしから始めました。

チラシを顔にかぶせて、何となくこんな感じ?

このくらいのサイズ?と適当にサイズを測り、厚紙に第一弾の形を作る。

まぁ、一発ではうまくいかないですね。

結構大きかったので、折りたたんで、サイズを測り直し、それをもとにもう一度型紙を起こします。

出来たのはこんな感じ。

それっぽい。

外周が青いのは、チャコの跡ですね。

とりあえずこれをベースに作成していきます。

使用した生地はダブルガーゼと、なんか触り心地のいい奴(雑)

顔に触れる方がダブルガーゼ(猫柄)です。

縫い方ですが、普通に2枚合わせて縫うだけ。

なので、これをざーっくり切ってざっくり合わせて適当に縫います(後々地獄を見ることに)

耳掛けですが、マスク用のゴムを使っています。

平ゴムも買っていて、耳じゃなくて頭にぐるっとする方法も考えていたのですが、今回はそこまで手が回らず。

ですが、1枚作るのに多分40分くらいでできます。

手芸が上手な人はもっと早いかもですね。

出来上がりはこんな感じ

外周を切った直後だったので、何となく綺麗に見えます。

仕上げに、チャコの色を落とすために手洗いをします。

:

:

:

:

:

:

:

:

モシャァ・・・

Ahhhhhhhhhhhhhhhhhhhhhhh!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!

ダブルガーゼだけどんどんほつれてしまいました。

端に考慮していなかったから。。。

結構ほつれるよ?それでいいの?と友人は言ってくれていたのですが、スルーした私がダメー!!

うーん、上からぐるりと断ち目かがりをしようと思っています。

今後作る分はロックで。

ゴム紐のところはちょっと考えないとですね。

ゴムを通す形にするっていうのも一つ

本当は11/25のイベントに間に合わせたかったのですが、1週間出張なので、ちょっと難しそう。。。

(イベントは↓。入退場自由、無料なので遊びに来てくださいな)

今回作った分のほつれをとりあえず切って持ってくくらいしかできないかな~

なかなか裁縫も奥が深いものですな。

作り直ししたら、第二弾としたいと思っています。

ではでは。

Oculus Goの中身をみんなで見ようぜ

11/16は札幌でDevFesがあって、今日なんか会社に誰もいないなーって思ってたらみんな参加していたらしいです。

え、私も行きたかったのにな。

なんだよもう。

本題。

Oculus Goのキャストを有効利用しよう

事の発端はこちら。

壁に白い紙を貼っつければVRのミラーリングできるかな、ディスプレイを持ち歩かずどこでも。 pic.twitter.com/jKpZh0lEuR

— 登嶋健太@福祉×VR (@KentaToshima) 2018年11月12日

OC5でOculus Goで見えている映像をスマホ側にミラーリングするキャストという機能が発表されたそうで。

それを利用+超単焦点プロジェクターでディスプレイいらず!を実行していらっしゃる!

早速パクりました(言い方)

やりかた

Oculus Goを起動します。

同じWiFiのネットワークにスマホとOculus Goをつないでおきます。

Oculus Go側で、「シェア」>「キャスト」を選択します。

スマホ側にキャスティングを開始するポップアップが出ますので、開始しましょう。

ほいで、超単焦点プロジェクターとの接続なんですが、私はiPhoneを使っているので、こんなのを使います。

これで、iPhoneとプロジェクターをHDMIで接続できます。

もちろん、ディスプレイがあればそちらに接続すると、部屋の明るさを気にすることはないですが、持ち運びを考えると、小型の超単焦点プロジェクターも良いですね。

実際に、やったやつ。

完全にパクらせて頂きました。

— サミィ(めっちゃ寒い) (@samy_hrin) 2018年11月16日

ディスプレイがいらない!(表示可否はアプリによる)

さってーさん(上司)に協力してもらいました~ pic.twitter.com/J0VmF3dlKn

でも、キャストはネットワーク使っているので、力尽きかけているモバイルWiFiだとちょっとダメな感じ。

ネット環境が良かったら、もう少し見栄えはいいんじゃないかなーと思います。

注意点その1

どんなルールがあるのかわかりませんが、キャストできないアプリがあるようです。

なんでかわからないですが、動画系で制限があるとか、

単純にバージョンに適用してないとか。

ちょっと理由はわからないのですが、NetFlixとUnityちゃんはだめで、Oculus roomsはOKでした。

注意点その2

キャスト機能は、最近のアップデートで追加された機能です。

Oculus Goがアップデートされていないと、キャストの機能もないし、

省エネモードも残メモリも確認できないんですね。(そうか、お前は出来なかったんだな。。。)

これ、やってないですか?

センサーを覆って、スリープに入らなくするの。

Oculus Goはスリープ中でネットワークに接続されているとき、15分、30分ってアップデート確認して、自動的にアップデートしているんだそうです。

(手動の方法はないらしい)

私のやつは全然アップデートされていなかったっぽいです!! (キャストが出るまで2時間くらいかかりました。。。)

スリープ嫌な人はセンサー被せ作戦ではなく、スマホのOculusアプリ

「設定」>「その他の設定」>「電源の設定」>「オートスリープ」

でスリープまでの時間を変えることが出来るので、これで対処しましょう。

ちなみに、今のバージョンは3.51.56.125526086です!

これなら確実にキャスト機能でまする。

以上、キャストテストでございました。

VTuberハッカソン2018 北海道大会に参加しました

掲題の通り。

去る11/10~11/11に開催されたVTuberハッカソンに参加してきました。

なにそれハッカってスースーするやつ?

いいえ、しないです。

終わっちゃいましたが、まだ本戦ありますので、概要は以下をご参照くださいな。

私はDoMCN(Hokkaido Motion Control Network)のグループにも参加させて頂いているので、お手伝いの段階からの参加。

非常に濃ゆい週末を過ごしました。

11/9 前日準備

準備の話をすると、もっと前に会場であった北海道情報専門学校にお邪魔させて頂いたりしたのですが、そこは割愛。

この日は大量の機器の荷ほどき、ナンバリングなどを主に行っていたようです。

というのも、私はお仕事で途中参加。

大きなことといえば、北海道ちゃんの受付リハ。

バーチャルキャストを利用して受付をしてみよう!という試みです。

とはいえ、環境もうまくいくのかわからないまま、試行錯誤を繰り返し繰り返し……

1FにあるPCと5FのPCをRICHOの会議アプリで接続、1Fのカメラ映像を5Fの画面内に表示し、バーチャルキャスト内に表示したデスクトップで確認する、というテスト中。

バーチャルキャストの映像を共有するために配信を噛ませるとラグがあったり、恋声での音声変換忘れて地声でしゃべったり、なんだか色々苦労したのですが、何とか可能な回線は出来上がりました。

当日の環境は @jun_mh4g さんが詳しくまとめてくださっています。

環境

— じゅん@mh4G 12/3-18 川崎遠征 12/26生体解析分科会@松山 (@jun_mh4g) 2018年11月12日

1F .@jojomonvr さんのつよつよゲーミングPC、RICOH R、Jabra Speak 510、RICOH UCS(360対応版)+バーチャルキャスト同時起動、(+本番当日 .@Q1J011 さん持参の外付けディスプレイ)

5F .@samy_hrin さんのつよつよゲーミングPC、Oculus Rift、バーチャルキャスト

LAN 学内orモバ

11/10 ハッカソン1日目

運営の朝は早い。

(絶対朝食べられないと思ったので、前日作成、ついでにいっぱい作った。

食べてくださったメンバーありがとうございますm( )m)

一日目は受付業務からスタート。

余裕ぶっこいてパンを食べてたのが後々あだとなることも知らず。。。

私がバ美肉して受付業務を行っているところは、公式さんが残していてくれていました(@vtuberhack)

VTuberハッカソン全国ツアー2018【北海道大会】

— VTuberhack (@vtuberhack) 2018年11月10日

受付はなんと北海道ちゃんが出迎えてくれる#VTuberHack#VTuberHackHokkaido pic.twitter.com/PBnfF5aFmR

多少トラブルがあり、来場されたすべての人をお迎え出来なかったと思うのですが、それっぽくは出来ていたようです。

私の方で状況みれなかったのですが、今回協賛いただいたデッドロックの大山さんがいらっしゃったときに、名前を呼んだらとても驚かれていたそうです。

それを聞けただけでも大成功v

さてさて、そろそろ開演ですよ。

実は今回の会場となった北海道専門学校さんより貸して頂いた会場は、出来たてほやほや、超きれいでつよつよPCがずらりと並ぶ超リッチなお部屋!

ユニティ・テクノロジーズ・ジャパンよりゲストでいらっしゃっていた常名さんが「この部屋だけでいくらの資産があるんだろう」と…

ヒェッ・・・( ;^ω^;)

それほど豪華な機器が使える今回のハッカソンでした。

Viveも、TSUKUMOのつよつよPCも、perception neuronも使い放題だよ!!!

この最高の環境でハッカソンするテーマはこれだ!

ハードル高し!

ドキドキしにそう。

そんなど素人に気持ちはよそに、ハッカソンは時間との勝負なのでどんどん進んでいきます。

まずはチームを作成しないとね、それのために、アイディアソンも行います。

アイディアソンでできた絵コンテ。

ゴールデンカムイの影響受けスギィィィィイイイ!

それでも、「いいねと思った作品につける星」いくつかいただきました。

ありがたや。

最終的に、私の参加したチームのアイディアはこちら。

最高にシュールでめっちゃ笑って一番好きでした!

チームが決まったあとは、もくもくと作品を作っていきます。

気が付いたら建造されているうまい棒タワー(撮り逃したけど、モンエナタワーもあった)

温かな応援に後押しされ、開発は続くのであった。。。

11/11 ポッキーの日ハッカソン2日目

すみません!!!私この日寝坊しました!

いや、なんかもう何も言うことはないです、家で音声録ってたけど、結局会場で録り直ししたし。

本当に申し訳ない。。。

個人的には躓いてスタートの2日目。

開発はどんどん熱を帯びています。

やはり開発佳境となると、写真を撮ってる余裕なんかないわけで

映像を収録している風景とか、わちゃわちゃしていてとっても面白かったんですが、お見せ出来ず残念です。

気を取り直して、私の参加させて頂いたチーム「ノープレッシャー」では、

「バーチャルサモナー道産子キスミ」というコンテンツを作成しました。

VTuberといえば、HMDが自分の視点、コントローラーが両手、トラッカーを追加して足などの動きを追従させると思うのですが、今回は従来の使用方法を一新!

カメラの視点がHMD、サケのアユミちゃんとキスミちゃん、それぞれを人形劇のようにコントローラーで操作します。

イメージはパペットマペット。

動画では採用されていませんが、アユミちゃんはモーションがついており、トリガーを引くと口の開閉(口パク)、タッチ部分の押し込みで頭を上下にできました。

(開発したのはHCS在籍の学生さん!技術力が高い!!)

また、このバーチャルサモナーですが、マルチメディア展開をしており、HP、各SNSが展開されています。

http://www.virtualsalmoner.shop/

はじめまして!

— 道産子キスミ (@vsalmoner) 2018年11月11日

道産子キスミと申します!

コラボ待ってま〜す!https://t.co/jw62A7c7HK#バーチャルYouTuber #VTuber #VTuberはじめました #VTuber始めました #バーチャルYoutuberはじめました #バーチャルYoutuber始めました #道産子VTuber #道産子キスミ #virtualsalmoner #初投稿

私はAsset漁ったり、声ちょっといじったり、PC貸してVive設置した程度でそんなに何もしていないのですが、チームの皆さんそれぞれの技術力が高く、素晴らしい作品が出来たと思います。

嬉しいことに、最後の審査では、バーチャルキャスト賞を頂きました!

今回、長時間行うハッカソンに初めて参加して、色々な技術を目の当たりにし、私も勉強ちゃんとしないといかんな!と気持ちを新たにした次第です。

まずはUnityかな、やっぱり。

動画編集もとても興味ありあり。

今後もこのようなイベントには積極的に参加していきたいと思います。

(そのためにも、べんきょう!)

--

宣伝

次回参加イベントはDoMCNでVR体験会のお手伝いをします~ 入退場自由、無料です!

札幌クリエイティブキャンプ3日目参加しました。

この記事は別のページより移行してきた記事です。(2018/6/19記載)

はじめに

先週に引き続き、SCC(サッポロクリエイティブキャンプ)に参加しました。

第3回です。

セミナー内容は

iPhoneアプリ開発Swiftプログラミング入門。拡張現実AR iPhoneアプリを作ってみよう!

でした。

講師はテクニカルライター/プログラマーの大重 美幸 氏です。

74冊の著書があり、もしかしたら名前を見たことがある、という人も少なくないのでは。

内容

今回はハンズオンではありません。

大重氏のスピードについていける分は手を動かしましたが、知識がない人はおとなしく聞いているのが○でした。

最低でも多少の知識があってよかった。。。

1時間目:iPhoneアプリの作り方

2時間目:Swiftシンタックス

3時間目:ARアプリ

講義を受けて

駆け足でしたが、一度Swift経験があったので、なるほど!!と思うことが多かったです。

なんというか、なんでも「おまじない」にしていたのですが、「おまじない」の「役割」を理解できたことは大きかったです。

何より、説明がめっちゃわかりやすい、、、(プログラム経験ゼロだと理解に至るかわからないですが)

独学もありですけど、有識者に教えてもらうことは、本当にショートカットルートです。

今回の講義の中で、ストーリーボードという画面を作り上げる機能の説明があったですが、

超便利!

うそん、なんで私頑なに使ってなかったんだろう。(まぁ、業務上の理由があったのですが)

知らなかったこと、気づかなかったことが自分の知識にプラスされるのはとても良いですね!

今回の講義で、正直iPhoneアプリを作るハードルが下がりました。

なんか、すぐ作れそう(毎回言ってない?)

シンタックスについては、タプルやオプショナルについての理解が深まったと思います。

個人的な話ですが、説明を読むより、同じ内容でも誰かに話してもらった方が理解度が高い。。

(文字読めてないんだな、多分)

今回の目玉のARですが、これはもうXcodeでプロジェクトを作るときにメニューにあります。

もうすでに色々な機能が搭載されています。

ARと言いながら、仕事をしているのはScene Kit。

平面検知をして、オブジェクトの配置をしたりできます。

ARに関しては、カメラを使用するのでEmulator上のデバッグはできません。

実機を繋いで行います。

(会社のMacbook Air借りましたが、私のiPhoneXに対してバージョンが低くて試せませんでした。。。

家のiMacでやります、そのうち)

もうVRもARもすぐ手が届くところにあるわぁ、という感じでした。

あと、Swiftは思ったより簡単だった。

おわりに

大重氏が2冊用意して下さっていたプレゼント本、じゃんけんで勝ち残ってGetしました。

これを使って、Swiftも勉強していきたい…

勉強したいものがどんどん積まれていく。。。

せっかくなので、有効に使っていきたいと思います。

以上です。

札幌クリエイティブキャンプ1~2日参加しました。

この記事は別のページより移行してきた記事です。(2018/6/15記載)

はじめに

タイトル通りですが、SCC(サッポロクリエイティブキャンプ)に参加しました。

第1回と第2回です。

セミナー内容は

「Unityで作る3Dアクションゲーム」の前・後編

でした。

講師はUnity Technologies Japan エバンジェリストの池和田 有輔 氏です。

Unityの中の人は結構北海道にも来てくれているんですよね。

エバンジェリストって忙しい。。。

内容

講義内容については詳しく書きませんが、簡単に書くと以下です。

1日目

- Unityのバージョン管理のお話

- 三人称視点カメラ「Cinema chine」の使い方

- ProBuilderを使用したポリゴンの作成(家を作る)

2日目

- ProBuilder応用(タル・階段を作る)

- ProGridとMaterial Editorを使う(葉っぱを作る)

- Particle systemを使う(土埃・蝶々を作る)

講義を受けて

今回、俗にいうノー勉で参加しました。

操作もまっっっっっっっっっったくわからない状態だったのでついていくのがやっとでした。

一旦わからなくなるとさっぱりついていけなくなってしまうのですが、そこはフォローして頂いて、なんとか全部終えられた感じでした。

別にプログラム経験者だから、とか、初心者だからとか、関係ないように思いました。

さて、Unityですが、今回の講義ではプログラムゼロ。

全てマウス操作と少しの数値入力で完結しました。

超便利じゃない???

懇親会でのお話で、今まではエンジニアさんの使用が多かったけど、これからアーティストの人たちに広く使って欲しい、難しいプログラムは機能として充実させて行くようにしたい、とのことでした。

講義内にあった三人称視点カメラも、元々有料のアセット(※)だったのを、開発者もろともUnityに引き込んだそうです。

それまでは個人でプログラムを組んだり、大きなゲームタイトルにはカメラエンジニアだけで2名いる、とかなんだそうです。

なんか、できそうな気がする!!!

あと、ポリゴンでのオブジェクト作成について、Unityに限らず覚えておくポイントが、「多角形は使わず、三角・四角形の組み合わせとする」というところです。

予期せぬ表示バグの回避になるそうです。

※アセット:UnityにはAsetts Storeなるものがあり、便利な機能、ポリゴン、効果などが展開されています。

ゲームに組み込むキャラクタなど、ゼロから作らずとも、アセットとしてストアにあります。

懇親会にて。

講義後の懇親会に参加しました。えぞキッチンの方(主催者)含めて11名くらい。

全員と名刺交換をしましたが、弊社とのお付き合いのある会社の方もいらっしゃって、

またよろしくお願いしますね、とお話をしつつ、モノノフさん(ももクロ好き)がいたので、仲良くなれそうな感じでした。

飛び交っていたワードの中で気になるところ。

Switchは半分くらいUnity製

Unityソムリエという人がいるらしく(笑うところ)これはUnity製だ、とわかったらしいが、最近は分かりにくくなっているらしい。ガイア

Unityのモジュール。勝手に地形とかを作ってくれるらしい。え、便利じゃね?

おわりに

初心者の第一歩としては、非常に興味をそそられる楽しいセミナーでした。

懇親会には既にUnityをバリバリ使っている方とかもいらっしゃいましたが、どんどん追加されるUnityの機能に、初耳だったこともあったようでした。

(池和田さんは、Release note なんて細かく見ないだろうし、バージョンアップした内容をどう伝えるか、みたいな話もしていました。本当に進化が早い)

敷居も低いですし、ゲーム以外に映像作成などもできるようです。

気になった方は、はじめてみてはどうでしょうか。

以上です。

バーチャルキャストでニコ生配信する手順

去る2018.10.20にVTuber勉強会なるものに参加しました。

多分、お手伝い的なことが出来たと思うのですが。

この時に、バーチャルキャストでニコ生に配信する方法+諸々をお勉強してきたのでまとめます。

違ってたら教えてVTuberの人。

さて、本題ですけど、PCスペックなどは省略します。

配信を行うまでに整えた環境についてです。

なお、設定時はOculus Riftを使用しています。

VIVEでも、基本同じかと思います。

バーチャルキャストを実施する環境は出来ている前提です。

バーチャルキャストの準備から始める場合は公式ページが参考になります。

はじめてのバーチャルキャスト|バーチャルキャスト[Virtual Cast]

必要な環境

配信に必要なもろもろ

ニコ生の有料アカウント

これがないと多分ソフトとか準備してもダメだと思います。

配信したい人はサクッと登録しましょう。

配信ソフト

配信映像をキャプチャするソフトが必要になります。

公式ページにはN Airと書かれています。

今回はN Airを用意しました。

えと、これだけです。

設定

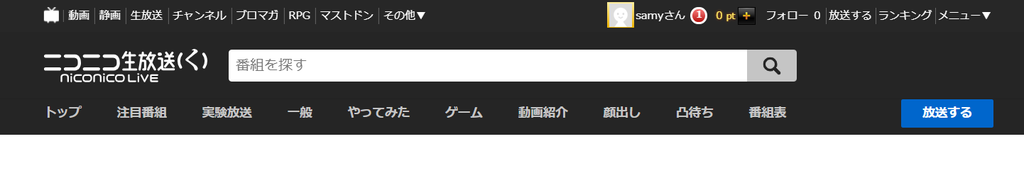

ニコ生の設定

まずは配信チャンネルを準備します。

ニコニコ生放送のページから、「放送する」をクリック。

放送チャンネルの情報を入れるページに移ります。

必須情報を入れて、あとはタグも入れておいた方がよいかもしれませんね。

必須項目を入力したら、「確認する」をクリックします。

入力に不足が無ければ内容と利用規約の確認ページに移ります。

問題なければ利用規約に同意するにチェックを入れ、「放送を開始する」をクリック。

この時にすぐ放送は始まらず、OFF AIRの状態なので安心してください。

見切れていますが、番組開始のボタンを押した時点から配信開始されます。

あ、切れてるのはわざとです。URL見えない位置で切ってます。。。

この後の準備が完了したら、配信するを押しましょう。

Virtual Castの設定

次はバーチャルキャストの設定。表記ゆれすみませんね、どっちがいいですかね。

カタカナでいいですかね。

さて、バーチャルキャストを起動します。

StearmVRを起動していないと多分起動しないのですが、この辺は大丈夫かと思います。

今回はニコ生配信主になりたいので、起動時はniconicoタグを選んでログインします。

ログインは、先の手順でニコ生設定していたニコニコのアカウントで行います。

ログインしたら、ニコ生の時の設定と同じように必須項目を埋めます。

サムネイルなども設定しておきましょう。

「凸先のスタジオID」は、今回使用しませんので、空白のままです。

さて、すでにニコ生の方で生放送の準備を整えているので、配信するチャンネルが取得できるはずです。

サムネイルの下の「番組情報を取得」を押してみます。

準備が出来ていないとエラーになりますが、準備が出来ていたら番組情報が取得できます。

スタジオに入る、をクリックするとバーチャルキャストの世界が起動します。 はやる気持ちを抑えて、一旦ここまで。

N Airの設定

ちょっとまだ細かい設定は謎なのですが、最低限の設定だけ。

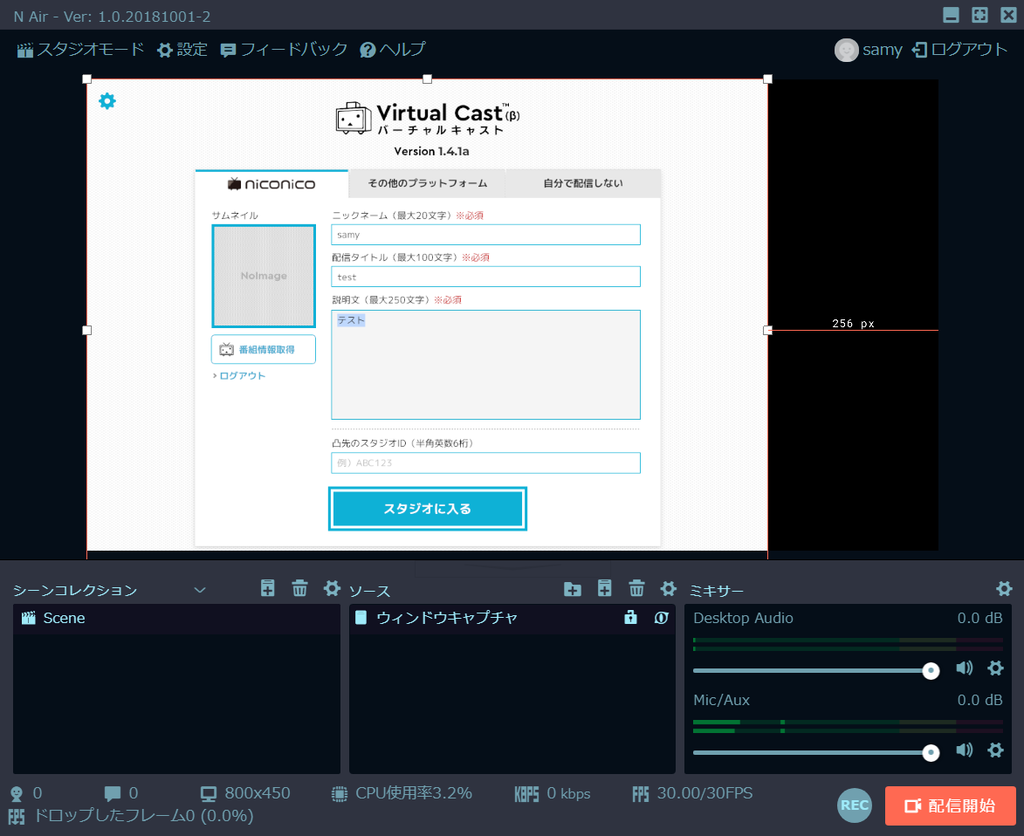

まずはN Air 起動します。

初回起動どんなか覚えていないのですが、多分、ニコニコにログインします。 これは最初に生放送のチャンネルを取得したニコニコのアカウントで入ります。

黒い

黒い

N Airの設定から行う細かな話は割愛します。

というか、まだあまりわかっていない。

最低限、出来るところまでやりますよ。

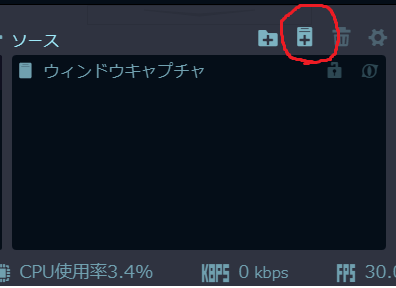

さて、下の真ん中にある、ソースの設定を行います。

これは、配信する映像のキャプチャ元を設定するところのようです。

「ソース」 の右横にあるバインダーにプラスみたいなアイコンをクリックします。

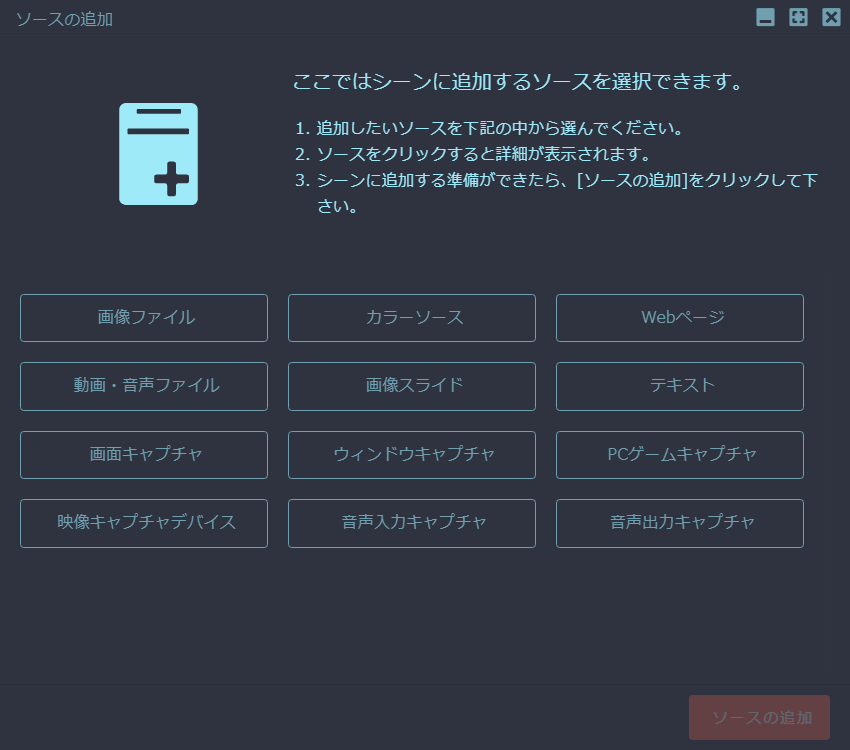

すると、どこをキャプチャ元にするのか選択する画面に遷移します。

ここでは、バーチャルキャストの画面をキャプチャしたいので、

ウィンドウキャプチャを選択します。

「ソースの追加」を押すと、設定画面に移ります。

まず、追加するソースの名前を求められるので、適当に入力して完了します。

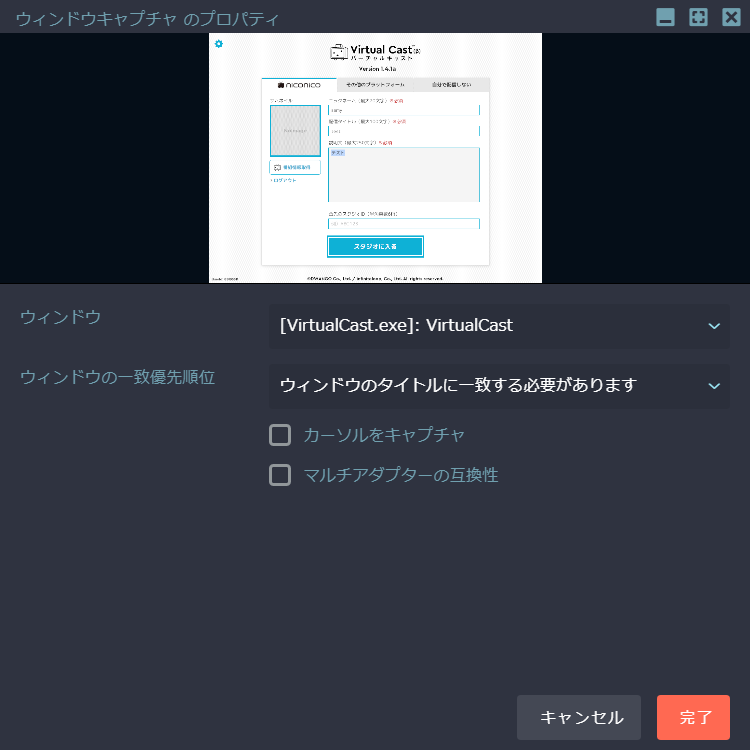

次に、キャプチャ元画面の設定をします。

すでにバーチャルキャストは起動済みですので、ウィンドウのリストから

「Virtual cast」を選択します。

すると、プレビューにバーチャルキャストの画面が表示されます。

あとは、カーソルのキャプチャは不要なので、もしチェックが入っていたら外します。

ここまでで完了します。

メインウィンドウに戻ると、バーチャルキャストの画面がキャプチャされている状態かと思います。

ただ、設定により黒の余白があったする場合があります。

これだと、配信した際に画面サイズが小さくなってしまいます。

これだと、256pxの余白が。。。

このへん、ちょうどよく設定する方法わからないので、あれば教えてください。

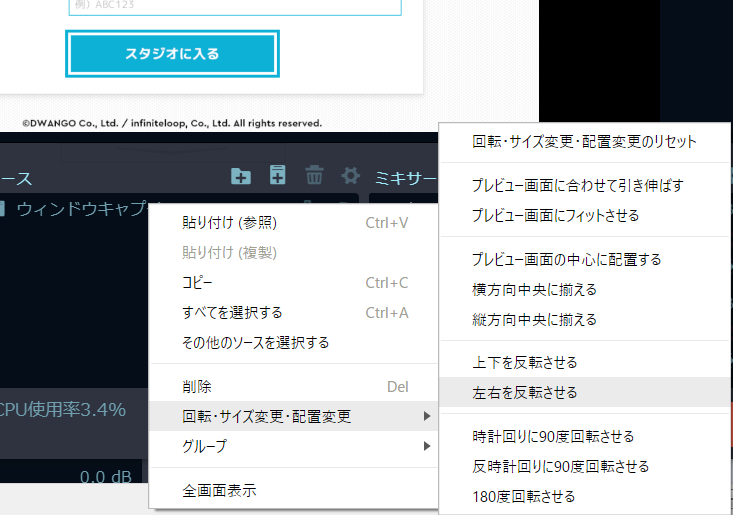

とりあえず、ソースの中に配置したウィンドウキャプチャを左クリックし、「回転・サイズ変更・配置変更」から「プレビュー画面の中央に配置する」にしておきます。

あと、配信時の画面解像度などは設定からどうぞ!

ほいで、左下の「配信開始」でニコ生の方に画面が反映されます。

・・・たぶん。

というのも、自宅の貧弱WiFiではニコ生側がずーっと読み込みぐるぐるしていて表示できず。

勉強会ではこれでできたと思うのですが、違ってたら教えてください。

お待たせバーチャルキャスト

さてさて、設定したまましばし放置だったバーチャルキャストですが、ようやくスタジオに入ります。

いつものトラッキング設定で、いざ仮想現実~

実は、N Airでサイズ微妙だったのが、バーチャルキャストのスタジオの画面に移ることでちょうどよく調整できたりします。

ちょっとHMD置いてるのであいえるたんがひどい格好ですが。。。

こんな感じでちょうどよい画面サイズに、あちこち引っ張ったり画面にフィットさせたりすると出来ます!

ちょうどよいなというところで、ニコ生の映像もみつつ、OKなら配信を開始しちゃってください。

あとは配信してみて、音が出てない~とか、でかすぎ~とか、諸々見てる人が教えてくれたり、熟練者の方が凸してくれるので勉強していきましょう!

※Twitterに投稿した画像をスタジオ内に落とす方法も聞いたので、これはまた別の記事にもう少しサクッと書きたいと思います。

以上です。

HoloLens 参考書読書会の遠隔お試しに行ってきた

この記事は別のページより移行してきた記事です。(2018/5/21記載)

【概要】

日時:2018.05.30 19:00〜

場所:株式会社インフィニットループ(本開催場所は東京)

内容: Hololensアプリの作成について、現在出版されている参考書は洋書のみなので、 みんなで読み進めましょう、という内容。今回が最終回。

対象者: ・Hololensアプリ開発やってみたい人 ・Unity初心者

対象書籍: Hololens Beginner's Guide Jason M. Odom著

参加した感想

本は4000円くらいだった。使わなかった。。。 でも、手元にあれば、順を追ってHololensアプリを作成できそうな一冊。 今回の読書会が本書の最終章にあたり、本当に札幌側は「お試し」という感じ。 次回の読書会開催時は、1回目から遠隔参加を予定とのこと。

本編より、前後にあった札幌会場内での交流、VR機器を体験させてもらう、というのがよかったです。 Hololensも体験させてもらい、他のVR機器とは違い、指で操作を行うのが未来的でかっこよかったです。 なかなか、タップ操作などのコツが掴みにくいのか、説明もしにくいし…という所有者のお話。 私はすぐタップできました。(ターゲットを視界に入れてから指を動かすんじゃ!) 他にもOculus GOで帯広の会場とVRチャットを繋いだり(読書会は東京ー札幌ー帯広で共有されていました)、新しい体験を色々させてもらいました。 VR酔いとか、処理落ちで画質が…とか色々ありますが、デフォルトコンテンツは思ったより悪くなかったです。 Hololensは視野角狭かったですが、VRゴーグルはそんなこともないし、コントローラーも扱いやすかったです。 ただ、ちょっと広い場所がないと、真価は発揮されないですね。 コントローラーで移動を操作するようなゲーム的な動きになると、酔いとか発生するのかもしれないです。

※一昨年のNoMapsにあったミクの4DXゲームですが、ミクはパンチラに厳しく、テストは角度調整で下から見上げたりと動き回ることが多くて、筋肉痛になったとか。裏話。。。

東京ではこのようなVR関連に止まらず色々なイベントがあるので、札幌も負けずに何か作って行きましょう!という感じでした。今後の予定もたくさん計画されているようです。